AI-оператор у кабіні: коли штучний інтелект стає членом екіпажу

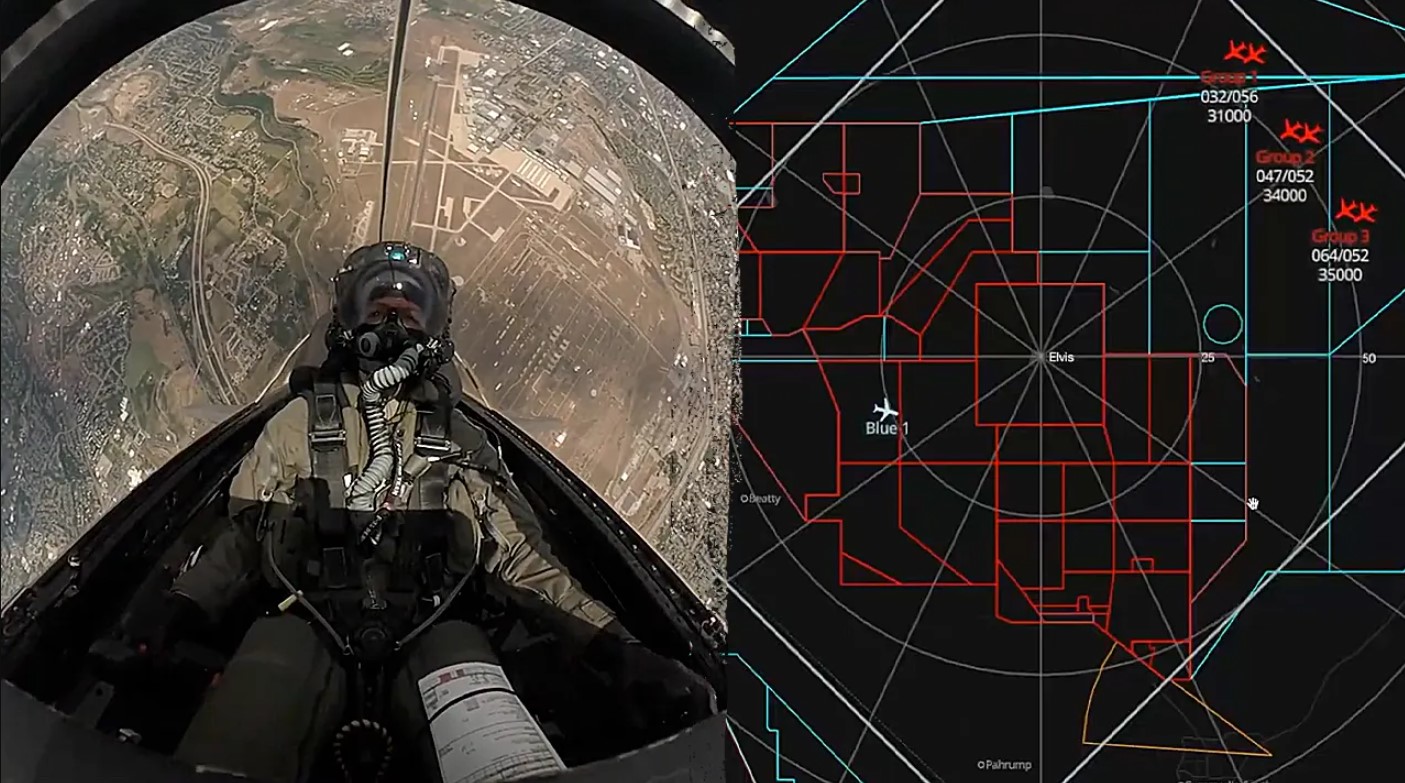

Штучний інтелект дедалі впевненіше виходить за межі аналітичних центрів і серверних — і заходить просто в кабіну бойової техніки.

Якщо ще кілька років тому AI сприймали переважно як інструмент обробки великих масивів даних, то сьогодні він стає повноцінним учасником екіпажу: підказує, аналізує, прогнозує й навіть веде діалог з людиною. Голосові інтерфейси, системи підтримки рішень, автоматичне розпізнавання загроз — усе це формує нову модель взаємодії, де машина не замінює оператора, а працює з ним у зв’язці.

Якою є межа між допомогою та автономією? Чи готові військові довірити алгоритмам частину функцій, від яких залежить безпека та успіх місії? І як змінюється сама логіка управління, коли людина визначає намір, а система пропонує оптимальний спосіб дії?

Про те, як AI-оператор стає «членом екіпажу», які технології вже працюють у реальних умовах і яких трансформацій очікувати найближчими роками, говоримо з кандидатом технічних наук, експертом з питань розвитку озброєнь та новітніх технологій Богданом Долінце.

— Що сьогодні мається на увазі під терміном «AI-оператор» в авіації — це розширений автопілот чи принципово нова роль?

— Коли ми говоримо про так званого АІ-оператора, то насамперед це принципово нова роль.Якщо автопілот працює в межах чітко заданих алгоритмів сценаріїв, то ШІ-оператор здатний аналізувати контент, поєднувати дані з різних сенсорів, пропонувати варіанти дій у різних ситуаціях, які можуть бути не прописані заздалегідь. А в оператора просто фізично може не бути часу або можливості їх продумати.

Отже, пропонуються оператору типові алгоритми або завчасно підготовлені сценарії розвитку подій, які він може на льоту сприймати і обирати. З’являється додатковий шар управління: це — людина, це — АІ-оператор і це вже безпосередньо сама машина.

Тобто військовослужбовець керує не напряму машиною, а співпрацює з інтелектуальним агентом-помічником, що дозволяє йому більш ефективно застосовувати і керувати цією машиною.

— Пане Богдане, ми переходимо від розуміння ШІ як «допоміжної програми» до концепції ШІ як члена екіпажу. Що саме вкладається в це поняття сьогодні? Це лише алгоритм чи повноцінний суб’єкт у кабіні?

— ШІ залишається виключно алгоритмом, хоч і дуже просунутим. Але він має власну картинку ситуаційної обізнаності, свою систему внутрішніх пріоритетів, і може мати певну здатність до самостійних дій у межах заданих правил. Тобто якусь частину рутинної роботи оператор-людина може делегувати такому ШІ-помічнику.

Тобто, з точки зору всієї екосистеми управління, це один із компонентів або навіть віртуальний член команди, який здійснює керування окремими системами або навіть загальним порядком дій.

— А які завдання машина вже сьогодні може брати на себе повністю, звільняючи когнітивний ресурс людини для прийняття стратегічних рішень?

— Розглядаючи питання ухвалення саме стратегічних рішень, маємо розуміти, що більша частина вирішальних ухвал залишаються за людиною. Але такі завдання, як моніторинг і аналіз великих масивів даних у реальному часі: параметри польоту, стан системи, дані сенсорів, інформації щодо зовнішніх загроз, людина просто не здатна сама на полі бою повноцінно, оперативно і ефективно опрацьовувати.

Тому ці задачі можуть бути оптимізовані зовнішнім ресурсом такого ШІ-пілота. Крім того, він може так само бути ефективним у певних тактичних завданнях. Наприклад, це оптимізація маршруту, ухилення від небезпеки, управління енергоспоживанням або балансування навантаження всередині системи, дозволяючи звільнити ресурси людини для концентрації на розв’язанні саме стратегічних завдань.

— Як змінюється філософія HMI (Human-MachineInterface)? Чи можна сказати, що ми рухаємось до повної відмови від фізичних важелів на користь інтелектуальних інтерфейсів?

— Тут все ж таки йдеться не про повну відмову, а про певну зміну підходів. Ми бачимо, що класичні фізичні органи керування залишаються як резервні або для застосування в аварійних сценаріях.

Але є певний основний тренд, до переходу саме до інтерфейсів, орієнтованих на наміри або на загальну концепцію. Це активно розвивається зараз, зокрема, в космічних технологіях.

Якщо взяти до розгляду систему ракет-носіїв, які виводять на орбіту космонавтів, то деякі з них вже відмовилися від великої кількості механічних або фізичних засобів керування на користь сенсорних панелей. Але це лише проміжний етап розвитку систем управління.

І наступним етапом буде можливість переходу до керування на основі намірів. Тобто коли пілот формулює завдання, яке він хоче досягти, а система пропонує певні шляхи або навіть реалізує це оптимальним шляхом з урахуванням безпеки та контексту.

— Голосове управління в цивільній авіації існує давно, але в бойових умовах це зовсім інший виклик. Як системи справляються з шумом, стресом пілота (зміною тембру його голосу) та перевантаженнями?

— Для систем управління побудованих саме на голосових алгоритмах керування важливим є використання ряду сучасних пристроїв. Це і багатоканальні мікрофони, використання кісткової провідності, сканування міміки обличчя та аналіз не лише слів, а й патернів мовлення. Особливо коли йдеться про поле бою, де додаткові шуми та інші чинники можуть бути значними. Зокрема, і вплив стресу на можливість прийняття людиною швидких та усвідомлених рішень.

Але, звісно, коли ми говоримо про голосові команди, то це лише один із каналів комунікації з людиноподібним інтерфейсом, де людина може озвучити свій намір чи плани, і далі машина може допомогти його реалізувати.

Нині ми бачимо вже появу і більш сучасних рішень. Тобто це розвиток так званих нейролінків або нейроінтерфейсів, які дозволяють навіть без слів і без будь-якого зовнішнього впливу формувати наміри, які можуть автоматично передаватися машині у вигляді команди.

— А чим діалоговий інтерфейс відрізняється від простих голосових команд? Чи здатна система «сперечатися» з оператором, якщо його рішення загрожує безпеці польоту або успіху місії?

— Як правило, такі системи не можуть, та й не повинні вступати в діалог чи в певну суперечку з оператором. Вони такої автономності не мають. По-друге, будь-яка суперечка або дискусія, вона фактично створює зниження уваги оператора-людини під час виконання місії. Це послаблює роль людини в такій системі.

Критично важливим є те, що в центрі будь-якого людиноподібно-машинного інтерфейсу завжди залишається людина, як ключовий гравець та диригент системи. Тому без довіри до системи та її алгоритмів не буде розуміння і не буде ефективності від такої взаємодії.

— Більш таке приземлене запитання, але все ж важливе. Наскільки критичним є питання мови та специфічної військової термінології? Чи навчаються такі системи розуміти контекст і сленг бійців «на ходу»?

— Наявні системи, побудовані на базі штучного інтелекту, повинні мати можливість розуміти не лише стандартні команди, але й контекст. Тобто навіть скорочення чи локальний сленг підрозділу, він має суттєве значення у стресових бойових умовах.

Тому творці будь-яких механізмів або моделей ШІ мають зважати на можливість адаптації агентів та урахування контексту окремо взятого користувача або цілого підрозділу для забезпечення реальної ефективності застосування таких помічників у бойових умовах.

— Одна з найбільших проблем — довіра людини до машини. Як пілот має зрозуміти, чому ШІ пропонує саме таку дію? Чи повинна система пояснювати логіку своїх рішень у реальному часі?

— Питання довіри є ключовим у будь-якій системі або людино-машинному інтерфейсі. Коли ж йдеться про штучний інтелект, питання стає ще більш гострим. Загалом пілоту не потрібно глибоко знати математику або ієрархії роботи нейронних систем: йому необхідно мати розуміння загальних ризиків та контролю.

Тобто залежність від рішень або пропозицій штучного інтелекту та які це може становити ризики. АІ може самостійно їх розраховувати та надавати людині-оператору. Друга важлива складова — це розуміння принципу роботи алгоритмів з точки зору фахівців.

Тобто розуміння того, що розроблені алгоритми отримали певний ступінь або кредит довіри від профільних фахівців, це дозволяє людині на нього покладатися.

— Чи не виникає ефекту «інформаційного перевантаження», коли голос ШІ в навушниках стає ще одним чинником стресу в критичній ситуації?

— Наявність голосу в гарнітурі — це лише один з інструментів або каналів комунікації, який може використовувати штучний інтелект. Він може так само адаптуватися до конкретних умов. І залежати від оперативної ситуації, її критичності та нагальності питання.

Можуть використовуватися аудіоканали, візуальні канали, навіть тактильна передача інформації. Крім того, не завжди це може бути голос: у деяких випадках це можуть бути певні послідовності звукових сигналів, тобто дзвінки або інші типи повідомлень. Дані підходи давно реалізовані в цивільній авіації для сповіщення пілота літака під час польоту.

Хороший АІ-оператор, він, як правило, «говорить» відносно рідко. Але дуже влучно, і в той момент, коли це має найбільшу цінність для оператора. Тобто він фільтрує інформацію, визначає пріоритети і вміє мовчати, коли ситуація не є критичною. До певної міри, він може прогнозувати і розуміти, чи оператор розуміє, що дійсно відбувається навколо. І лише виявивши, що контекст випадково проігнорований або не був коректно проаналізований людиною, тоді тільки почне про нього нагадувати.

По суті, схожі системи ми вже бачимо в автомобілебудуванні. Наприклад, коли бортовий комп’ютер автівки може визначати за певними непрямими показниками, що людина себе погано почуває або є сонною, і відповідно продовження маршруту її на автомобілі може призвести до дорожньо-транспортної пригоди. І тоді машина унеможливлює продовження поїздки або вимагає від водія зупинитися для відпочинку.

— Edge AI: Наскільки потужними мають бути обчислювальні модулі безпосередньо в кабіні, щоб підтримувати складні діалогові моделі без затримок і без звернення до хмарних серверів?

— Загалом, йдеться про достатньо потужні і продуктивні системи, які матимуть гарантовані мінімальні затримки на рівні мілісекунд. Це коли ми говоримо про повну незалежність таких модулів від зовнішніх мереж та без доступу до мережі «Інтернет» і зовнішніх обчислювальних центрів.

По-друге, це вже не є якимось окремим комп’ютером, а це повноцінний елемент авіоніки, спроєктований за стандартами надійності і безпеки.

— Як захистити такий зв’язок від ворожого перехоплення або «спуфінгу», коли противник може спробувати віддати голосову команду системі?

— По-перше, таке спілкування будується як багаторівнева платформа. Це алгоритми біометрії голосу, його розпізнавання і фільтрація від інших голосів. Це особливі поведінкові патерни оператора, контекст місії і фізичні параметри середовища. Тобто система реагує не на звук як такий, а на цілий набір особливих ідентифікаторів оператора в завчасно визначеному контексті. Такий підхід дозволяє мінімізувати будь-які зовнішні впливи.

По-друге, звісно, це обмеження доступу до сторонніх джерел інформації. Тобто те, що ми маємо вміти працювати автономно. Навіть без доступу до мережі «Інтернет».

— Ви вже частково торкнулися цього питання, але, якщо можна, більш широко про наступне. Чи бачимо ми потенціал у використанні ШІ для моніторингу стану самого пілота (втома, гіпоксія, страх) через аналіз його мовлення та команд?

— У цілому вже є рішення у світі технологій, які дозволяють отримувати велику кількість інформації за так званими непрямими показниками. Це аналіз не тільки мови, а й серцебиття, тиску, насичення крові киснем, або навіть зовнішній стан: рухи, розширення зіниці чи швидкість їх зміни.

І це ті параметри, які дозволяють отримувати багато додаткової інформації, про яку навіть сама людина-оператор може не знати або не реагувати на свій стан.

Потенціал ШІ в цьому напрямі є дуже значним. Якщо ми говоримо про впровадження нейроінтерфейсів, то це дозволятиме таким системам бачити людину, її стан з дуже глибокою деталізацією. Її параметри життєдіяльності, які у звичайних життєвих ситуаціях треба тестувати через різні лабораторні дослідження.

Командири це все зможуть бачити в реальному часі. По-друге, це дозволятиме не просто виявляти, але й попереджати певні стани: зміна настрою, коливання рівня втоми, панічні атаки тощо.

— На вашу думку, пане Богдане, як поява AI-операторів змінить підготовку льотного складу? Чи будуть пілотів майбутнього навчати насамперед «менеджменту штучного інтелекту», а не власне пілотуванню?

— Говорячи про появу АІ-операторів у майбутньому, зокрема і про їхню підготовку, то вона має включати не тільки компетенції Hardskills (технічні навички — ред). Тобто не лише уміння літати, а й взаємодіяти з автономними агентами, розуміти їх обмеження, знати коли, як і як саме їх використовувати, а коли краще уникати застосування даних інструментів.

Фактично мова йде про зміну концепції процесу підготовки льотного складу — замість підготовки технічних фахівців-виконавців відбудеться перехід до підготовки фактично диспетчерів-менеджерів автономних систем.

— На вашу думку, наскільки Україна нині інтегрована в ці процеси? Чи є в нас розробки, що дозволяють впроваджувати елементи голосового управління або діалогових систем у наші безпілотні комплекси?

— На сьогоднішній день Україна має власний практичний досвід роботи з елементами ШІ автономії. Це і голосове управління, і Edge AI тощо. Особливо ці рішення себе проявили в безпілотних системах.

Але найбільшою перевагою України є саме реальний бойовий досвід використання таких систем. Швидка ітерація зміни та адаптування рішень під існуючі виклики на відміну від інших країн, де такої можливості немає. По-друге, це поява і генерування великої кількості ідей для подальшого розвитку і застосування таких систем.

— Ну і наостанок традиційно, як для наших з вами розмов: про перспективи. Якою ви бачите кабіну пілота майбутнього через умовних 5-10 років? Наскільки там буде високою присутність людини і скільки алгоритмів? Чи чекає на нас у майбутньому кабіна взагалі без крісла для людини, де AI-оператор стане єдиним господарем?

— Простір такої кабіни майбутнього буде надалі ставати все більш мінімалістичним та напрошувати рівень автономії. А людина, по суті, у даній кабіні виконуватиме ключову роль стратега. Або певного адміністратора-контролера за роботою всієї групи бойових систем.

Але технічна кабіна без людини є неможливою. Адже не обов’язково цей простір буде на борту самої бойової платформи. Тобто на літаку чи на якомусь іншому апараті: вона може бути і в спеціальному безпечному центрі проведення операцій на землі та мати захищений надійний зв’язок, який дозволяє людині здійснювати таке директивне або командне управління загальною системою в реальному часі.

Далі такі системи навіть включатимуть, крім звичайних сенсорних та механічних елементів управління, ще й елементи так званого нейрозв’язку, коли людині не обов’язково буде виконувати дії руками або щось проговорювати: вона зможе лише своїми думками та намірами впливати на зміну стану бойової системи.